研究例(~2021)

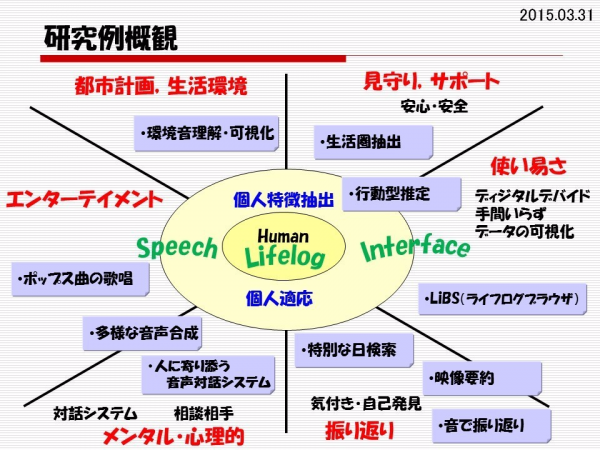

ここでは,具体的な 研究例をいくつか紹介します.最初に各研究例の位置づけを説明しておきましょう.下図を見てください.図の中心に示されているように,人間から収集したデータを利用して2つのことを行います.1つ目はデータからの個人特徴の抽出です.データを提供してくれた人がどんな人であるかを理解します.2つ目は,その特徴を利用してその人に適した処理をします.その人が使いやすいように機器を自動的に操作したり,その人が必要としている情報を提供したりします.この2つのことは,様々なサービス分野で共通的に行われます.現在のところ,図に赤字で書いた,安心安全のための見守り,使い易いデータの可視化,思い出の振り返り支援,心理的な負担が少ない対話システム,音声によるエンターティメント,音による生活環境モニタリングなどに着目して研究を進めています.

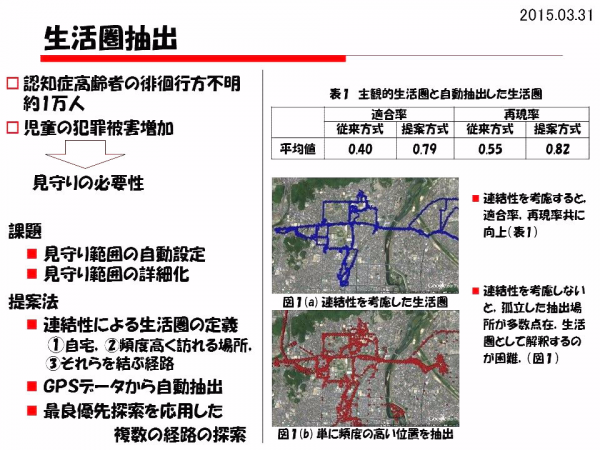

生活圏抽出

- Yuji Matsuo, Sunao Hara, Masanobu Abe, “Algorithm to estimate a living area based on connectivity of places with home,” C. Stephanidis (Eds.), HCI International 2015 - Posters’ Extended Abstracts, Part II, CCIS 529, pp. 570–576, Springer International Publishing, Aug. 2015.

- 松尾雄二,原直,阿部匡伸,“滞在地と経路に着目した生活圏抽出法,” 電子情報通信学会技術研究報告,Vol. 114, No. 500, LOIS2014-74,pp. 77–82,March 2014.

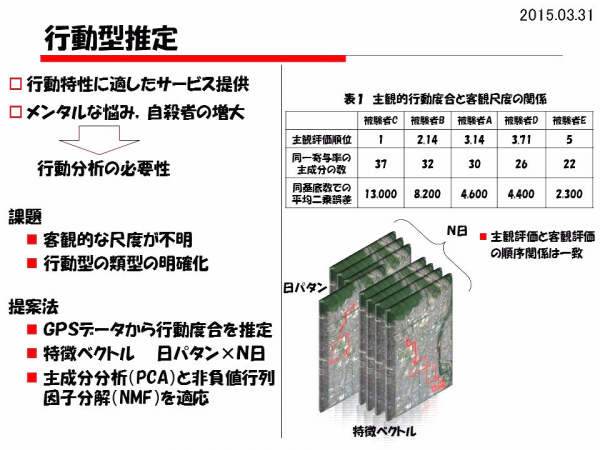

行動型推定

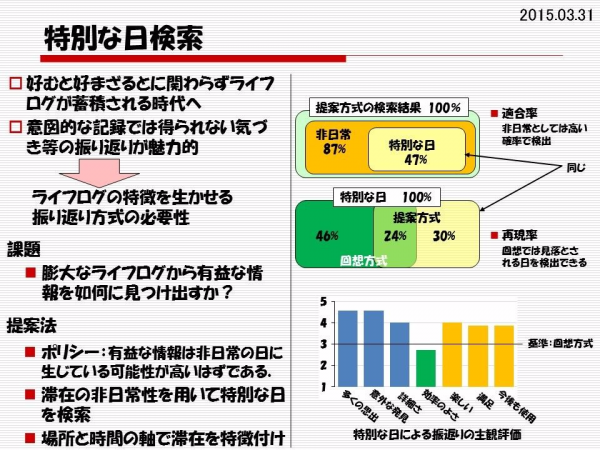

特別な日検索

林啓吾,原直,阿部匡伸,“滞在地の特徴量を利用した「特別な日」検索方式,” 電子情報通信学会技術研究報告,Vol. 114, No. 500, LOIS2014-76,pp. 89–94,March 2014.

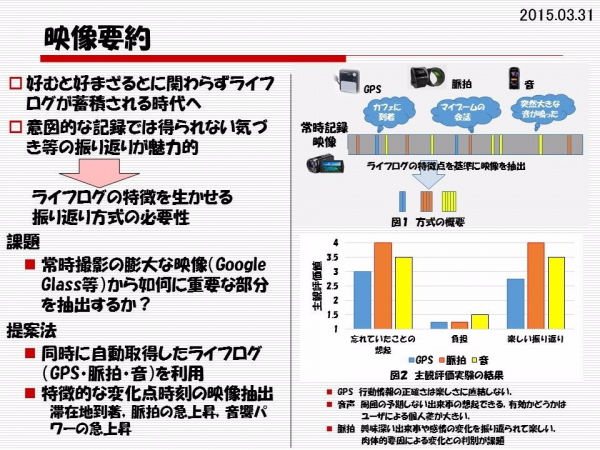

映像要約

大西杏菜,阿部匡伸,原直,“振り返り支援における効率的な映像要約のための自動収集ライフログ活用法,” 電子情報通信学会技術研究報告,Vol. 115, No. 27, LOIS2015-1,pp. 23–28,May 2015.

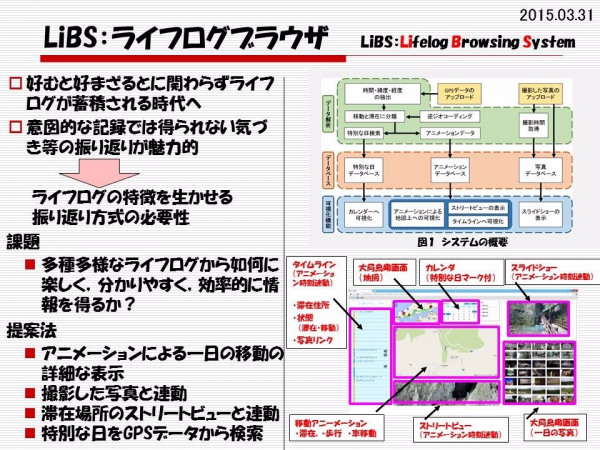

ライフログブラウザ

- Atsuya Namba, Sunao Hara, Masanobu Abe, “LiBS: Lifelog browsing system to support sharing of memories,” Proceedings of UbiComp/ISWC 2016 Adjunct, pp.165–168, Heidelberg, Germany, Sept. 2016.

- 難波敦也, 原直,阿部匡伸,“LiBS:発見と気付きを可能とするライフログブラウジング方式,” マルチメディア,分散,協調とモバイルシンポジウム(DICOMO2015), pp. 1741–1748, 8E-4, July 2015.

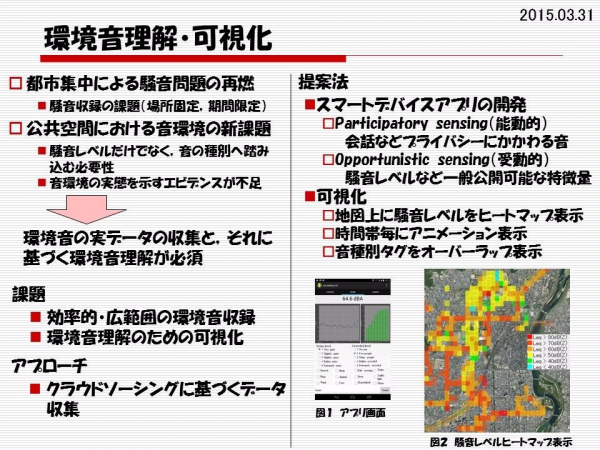

環境音理解・可視化

原直,阿部匡伸,曽根原登,“聴取者の主観評価に基づく音地図作成のための環境音収録,” 2015年日本音響学会春季研究発表会, pp.81–82, 2-1-15, March 2015.

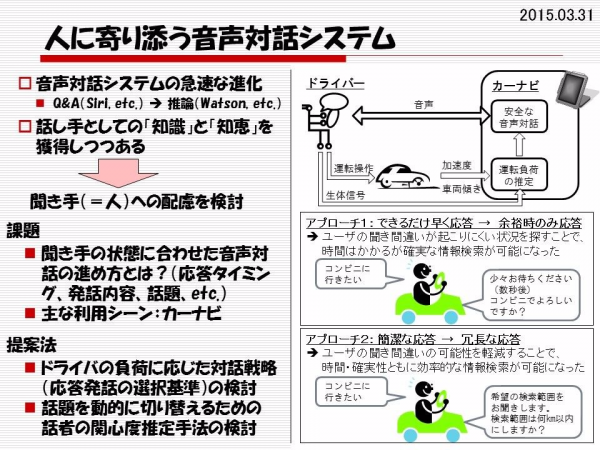

人に寄り添う音声対話システム

- 山岡将綺,原直,阿部匡伸,“車載用音声対話システムにおけるユーザ負荷を考慮した対話戦略の検討,” 情報処理学会技術報告, vol. 2014-SLP-101, (vol. 2014-NL-216), no. 7, pp. 1–6, May 2014.

- Masaki Yamaoka, Sunao Hara, Masanobu Abe, “A Spoken Dialog System with Redundant Response to Prevent User Misunderstanding,” APSIPA Annual Summit and Conference 2015, pp. 223–226, Hong Kong, Dec. 2015.

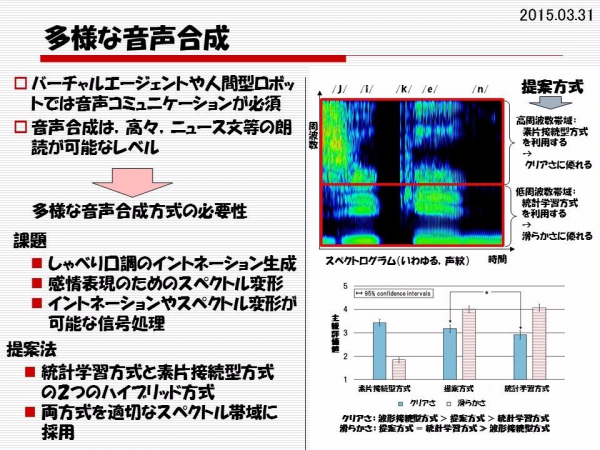

多様な音声合成

- Tadashi Inai, Sunao Hara, Masanobu Abe, Yusuke Ijima, Noboru Miyazaki and Hideyuki Mizuno, “A Sub-Band Text-to-Speech by Combining Sample-Based Spectrum with Statistically Generated Spectrum,” Interspeech 2015, pp. 264–268, Dresden, Germany, Sept. 2015.

- 稻井禎,原直,阿部匡伸,井島勇祐,宮崎昇,水野秀之,“高域部への素片スペクトルとHMM生成スペクトルの導入によるHMM合成音声の品質改善の検討,” 2015年日本音響学会春季研究発表会, pp.383–384, 2-Q-36, March 2015

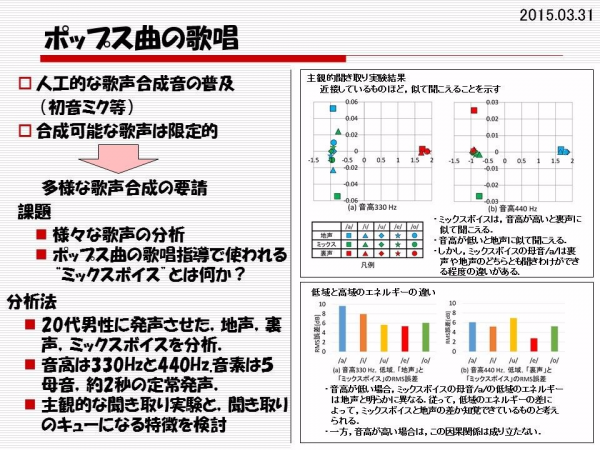

ポップス曲の歌唱

家村朋典,原直,阿部匡伸,“ミックスボイスの地声・裏声との類似度比較,” 2015年日本音響学会春季研究発表会, pp.427–428, 2-Q-51, March 2015

コンピュータがしゃべる。どうやって?

2014.07.12 @東京ビックサイト

夢ナビライブ